“目前,(AI大模型)风险是可控的。但当‘信息智能’延伸到‘物理智能’,‘生物智能’也开始使用时,此时(AI大模型的)风险会比较大。”

清华大学智能产业研究院院长、中国工程院院士张亚勤24日在中国发展高层论坛(CDF)2024年年会期间的一场研讨会上表达了上述观点,该研讨会主题为“人工智能发展与治理”。

张亚勤认为,目前,人工智能已发展到大模型时代。未来5年里,大模型可能在各个领域都进入大规模应用阶段, 并由此产生三层风险。

第一层风险是信息世界的风险。张亚勤说,目前,人类所应用的大部分智能还属于“信息式的智能”,海量的信息中不乏错误的信息和虚假的信息。

第二层风险则是与生物智能发展密切相关。张亚勤认为,伴随机器人、无人机等技术发展和应用,信息智能已逐步与物理世界相连。当大模型进一步与生物体、人类大脑连在一起的时候,风险可能规模化。

“脑机接口”是张亚勤“点名”的一类生物智能。所谓“脑机接口”,首都医科大学宣武医院院长赵国光曾作出通俗的解释:通过采集人的意念,经过算法处理、信号分析,将其转化为机器可识别的指令,并支配气动手、机械臂、轮椅等外部器械,实现脑机联合。

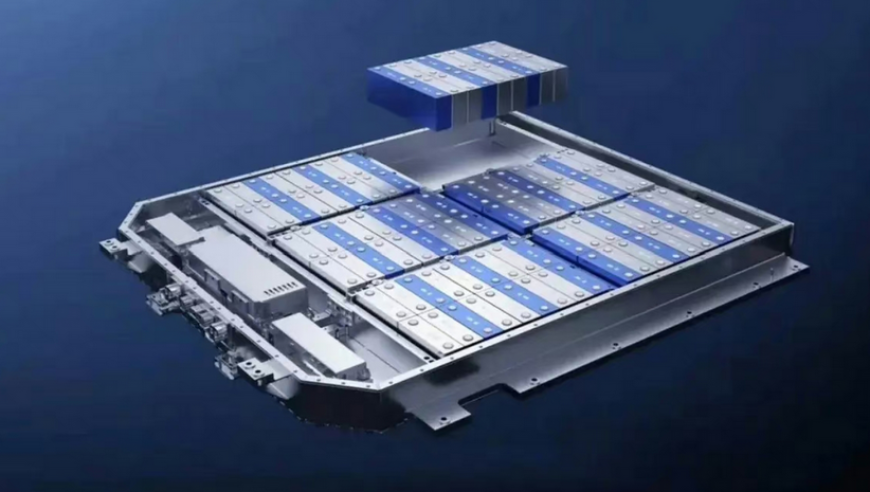

作为人脑和电脑连接的桥梁,脑机接口为难治性神经系统疾病治疗打开了巨大的想象空间。据市场机构预测,脑机接口 (BCI) 市场正处于转型增长期,预计到2030年将达到59.9亿美元,复合年增长率高达15.9%。

但该技术也存在伦理方面的隐患——当瘫痪患者因脑机接口技术重获与外界交互的能力,普通人可能借助脑机接口变成超人吗?今年2月科技部印发的《脑机接口研究伦理指引》,对这种为“普通人变超人”带来可能性的“增强型脑机接口研究”作出特殊要求。

再进一步看,张亚勤还表示,未来五年里,当AI大模型再连到现实世界中的经济体系、金融体系、军事系统,影响电力等网络,也可能产生较大隐忧,这是第三层风险。

“(对于进入AI时代)人们其实完全没有做好准备,无论是在治理,还是在就业方面。” 香港大学教授、当代中国与世界研究中心主任李成在同场研讨会上也表达了相似的担忧。

李成提到他近期参加两场AI治理有关的跨国闭门会议的经历。“与会者都是全球领先的科学家,大多数来自于西方国家。当时有54个国家的首脑都参与了那个会议,探讨AI这个话题。AI其实已经是一头灰犀牛了,但是没有人能够预测它能够这么快、这么大规模地出现在我们的社会里面。”李成说。

怎么解决这些问题?张亚勤提出了多点建议,其中之一是未来需要科学家、技术从业者和企业家一起“边发展边治理”。“我呼吁把10%的经费投入到大模型风险的研究里面去,这个研究不仅仅是政策研究,还有其中的很多算法、技术的研究。”张亚勤说。

清华大学苏世民书院院长薛澜在该场研讨会上也给出5点治理建议:第一,要加强安全领域的技术研发和国际合作;第二,敏捷治理可能是这个时代需要考虑的一种模式;第三,鉴于外界的规制难以解决信息不对称的问题,要鼓励企业的自我规制,并建立相关机制;第四,倡导全球化治理;第五,减少地缘政治对全球科技发展和治理的负面影响。

“比如,在人工智能领域中美双方一定要加强合作,这样才能真正解决人类面临的各种问题。”薛澜说。

根据张亚勤的观点,当前的AI大模型尽管已经在各个领域广泛应用,但仍然存在三个主要风险:

1. 信息世界的风险:由于AI的大规模应用,大量信息可能会包含错误或虚假的信息。

2. 与生物智能相关的风险:随着机器人和无人机等技术的发展和应用,AI与生物体的联系逐渐增强,这可能导致风险的规模化。

3. 生物智能风险:脑机接口(BCI)是另一种涉及AI风险的技术,它能够将意念转化为机器可识别的指令,并控制外部器械。

针对这些风险,专家建议我们需要采取多种措施来应对:

1. 加强安全领域的技术研发和国际合作,以应对信息世界的风险。

2. 敏捷治理可能是当前需要考虑的一个模式,因为它能更快速地反应变化。

3. 倡导全球化治理,因为规则难以解决信息不对称的问题。

4. 减少地缘政治对全球科技发展和治理的负面影响,例如中美之间的合作。

总的来说,张亚勤强调我们需要充分认识到AI风险的重要性,并采取有效的策略来应对。同时,他也提醒我们应重视信息素养和道德教育,以确保AI技术的应用能够造福于所有人。